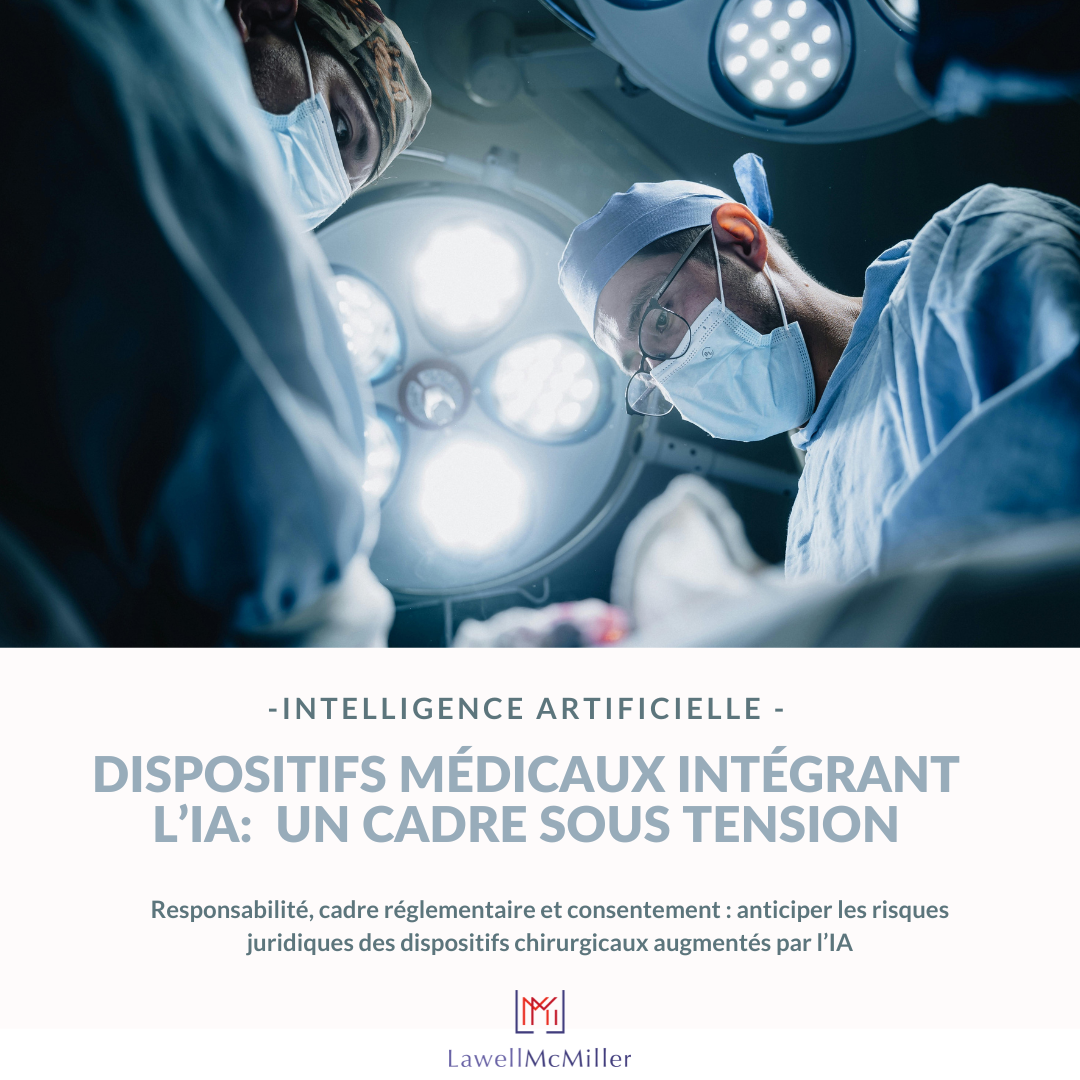

INTELLIGENCE ARTIFICIELLE - DISPOSITIFS MEDICAUX INTEGRANT L'IA : UN CADRE SOUS TENSION

Responsabilité, cadre réglementaire et consentement : anticiper les risques juridiques des dispositifs chirurgicaux augmentés par l’IA

Depuis l’intégration croissante de l’intelligence artificielle dans les blocs opératoires, les signalements d’incidents impliquant des dispositifs chirurgicaux augmentés par IA se multiplient.

L’IA s’installe progressivement en salle d’opération : assistance à la navigation, reconnaissance anatomique en temps réel, aide au geste chirurgical.

La promesse est connue : plus de précision, moins d’erreurs humaines.

Mais plusieurs enquêtes et données issues des systèmes de vigilance sanitaire montrent une hausse des déclarations d’événements indésirables liés à certains dispositifs intégrant des fonctionnalités algorithmiques.

Cette évolution soulève des questions juridiques très concrètes.

- Un cadre réglementaire sous tension

Les dispositifs médicaux intégrant de l’IA sont, en grande partie, évalués dans des cadres réglementaires conçus pour des technologies dont le fonctionnement est stable.

Or, certains systèmes algorithmiques peuvent être mis à jour, ajustés ou optimisés après leur mise sur le marché. Comment encadrer juridiquement un outil dont les performances peuvent évoluer ? Comment assurer une surveillance post-commercialisation réellement adaptée ? Quelle transparence sur les données d’entraînement et les limites connues du système ?

- Responsabilité : une chaîne plus complexe

Dans un cadre traditionnel, le professionnel de santé est responsable de ses actes et de ses décisions cliniques. Mais lorsqu’une décision est assistance par un système algorithmique, plusieurs acteurs peuvent être impliqués:

- Le fournisseur ou fabricant du logiciel ou du robot si le produit présente un défaut ou a été insuffisamment testé ;

- Le praticien ou l’établissement de santé si l’utilisation ou l’intégration de l’outil ne respecte pas les standards de diligence ;

- Dans certains cas, une combinaison de responsabilités peut être envisagée.

La doctrine juridique souligne que les régimes classiques de responsabilité (négligence médicale, responsabilité du fait des produits) nécessitent une adaptation pour tenir compte de l’IA comme facteur contributif.

- Le consentement éclairé à l’ère algorithmique

Si une technologie algorithmique participe à l’acte médical, l’information du patient ne devrait pas être limitée à un outil médical anodin. L’usage d’un système d’IA implique une information claire sur ses limites, son rôle et les risques potentiels, afin que le patient puisse donner un consentement véritablement éclairé. Des lignes directrices éthiques recommandent d’ailleurs d’intégrer cette information dans le processus préopératoire.

- En tant qu’avocats, nous constatons que l’IA dans le secteur de la santé est bien plus qu’une question technologique : elle met en jeu des enjeux de régulation, de responsabilité et d’information des patients, qui devront être anticipés à la fois par les législateurs, les professionnels de santé et les acteurs de l’innovation.

- La question n’est plus seulement “peut-on utiliser l’IA ?”, mais “dans quelles conditions juridiques, cliniques et éthiques peut-on le faire en protégeant les patients et les praticiens ?”

- Anticiper la responsabilité, sécuriser les contrats, structurer l’information au patient et intégrer les exigences réglementaires en amont devient essentiel.

.png)